Az AI potenciális barátunkká is válhat? Egy etikaprofesszor rávilágít arra, hogy miért rejthet veszélyeket ez a gondolat.

Itt található az "on the other hand" rovat a Portfolio oldalán, ahol a szerzők saját véleményüket osztják meg. Fontos megjegyezni, hogy ezek a nézőpontok nem mindig tükrözik a Portfolio szerkesztőségének hivatalos állásfoglalását. Ha szeretne hozzászólni a témához, ne habozzon, küldje el írását a [email protected] címre. A megjelent cikkeket itt érheti el.

Mark Zuckerberg, a Meta első embere, és Sam Altman, az OpenAI vezetője határozottan népszerűsítik azt a nézetet, hogy mindenkinek - a gyerekeket is beleértve - érdemes lenne "AI-barátokat" vagy "AI-társakat" kialakítania. Eközben a nagyvállalatok a mesterséges intelligencia ügynökök fogalmát erőteljesen terjesztik, amelyek célja, hogy támogassanak minket mind a magánéletünkben, mind a szakmai területeken, miközben rutinfeladatokat végeznek el és segítik a döntéshozatali folyamatokat.

A valóság az, hogy az AI-rendszerek nem tekinthetők barátoknak, társaknak vagy ügynököknek – és valószínűleg soha nem is fognak. Ezek pusztán gépek, és ez a státuszuk nem változik meg. Őszinte beszélgetéseket kell folytatnunk erről, és aktívan fel kell lépnünk a félrevezető marketinggel szemben, amely azt sugallja, hogy az AI képes emberi érzelmeket vagy kapcsolatokat kialakítani.

A mesterséges intelligencia a legmegtévesztőbb kifejezés.

Ezek a rendszerek valójában nem igazi intelligenciával bírnak; amit manapság mesterséges intelligenciának hívunk, az csupán olyan technológiai megoldások gyűjteménye, amelyek bizonyos kognitív funkciókat utánoznak. Nincsenek képesek a valódi megértésre, és nem rendelkeznek objektivitással, tisztességgel vagy semlegességgel.

És nem lesznek egyre okosabbak. Működésükhöz az AI-rendszerek adatokra támaszkodnak, és ez egyre inkább magában foglalja az olyan eszközök által generált adatokat is, mint a ChatGPT. Ennek eredménye egy olyan visszacsatolás, amely a kimenetet újrahasznosítja anélkül, hogy mélyebb megértéssel járna együtt.

Az intelligencia lényegét nem csupán a feladatok hatékony megoldása adja, hanem az is, hogy miként közelítik meg és valósítják meg ezeket a kihívásokat. Bár az AI-modellek lenyűgöző technikai tudással bírnak, mégis csupán meghatározott területekre specializálódtak, mint például a hatalmas adathalmazon való navigálás, logikai következtetések levonása és bonyolult számítások végrehajtása.

A szociális intelligencia terén azonban a gépek csak szimulálni tudják az érzelmeket, az interakciókat és a kapcsolatokat. Egy orvosi robotot például be lehetne programozni arra, hogy sírjon, amikor egy beteg sír, de senki sem állítaná azt, hogy ilyenkor a robot valódi szomorúságot érez. Ugyanezt a robotot ugyanilyen könnyen be lehetne programozni arra is, hogy vágja pofon a beteget, és ugyanolyan precízen hajtaná is végre ezt a parancsot - ugyanannyira hitelesség és öntudatosság nélkül. A gépek nem "törődnek" ilyen dolgokkal; egyszerűen csak követik az utasításokat. És bármennyire is lesznek fejlettek ezek a rendszerek, ez nem fog változni.

Egyszerűen megfogalmazva, a gépekből hiányzik az a képesség, hogy figyelembe vegyék az erkölcsi szempontokat a működésük során.

Viselkedésüket az emberek által létrehozott minták és szabályok irányítják, míg az emberi erkölcs az autonómiában gyökerezik - abban a képességben, amely az etikai normák felismeréséhez és az annak megfelelő viselkedéshez szükséges. Ezzel szemben az AI-rendszereket a funkcionalitásra és az optimalizálásra tervezték. Öntanulással alkalmazkodhatnak, de az általuk generált szabályoknak nincs eredendő etikai jelentésük.

Vegyük például az önvezető autókat. Ezek a járművek képesek olyan stratégiákat kidolgozni, amelyek segítségével A pontból B pontba a lehető leggyorsabban eljuthatnak. Az utazási idő minimalizálása érdekében az önvezető autók különféle szabályokat alkalmazhatnak. Ha az emberek elgázolása elősegítené a cél elérését, a jármű képes lenne ezt végrehajtani, kivéve, ha kifejezett utasítást kapott arra, hogy ezt ne tegye. Azonban az autó nem képes felfogni az ilyen döntések erkölcsi következményeit, így nem érti, hogy az emberek sérülése milyen súlyos következményekkel járhat.

Ez a helyzet részben abból fakad, hogy a gépek nem képesek felfogni az általánosíthatóság alapelvét – azt a gondolatot, hogy egy cselekedet csak akkor tekinthető etikusnak, ha egy általános szabályként megállja a helyét. Az erkölcsi ítéleteink megalapozása attól függ, hogy tudunk-e olyan ésszerű érvet felhozni, amelyet mások is elfogadnak. Ezeket gyakran "jó okoknak" nevezzük. Ezzel szemben az emberek, a gépekkel ellentétben, képesek olyan gondolkodásmódra, amely figyelembe veszi az általánosítható erkölcsi szempontokat, így képesek megítélni cselekedeteik helyességét vagy helytelenségét.

Az adatalapú rendszerek (DS) kifejezés ezért megfelelőbb, mint a mesterséges intelligencia fogalma, mivel azt tükrözi, amire a mesterséges intelligencia valójában képes:

Az adatok generálása, gyűjtése, feldolgozása és kiértékelése révén lehetőség nyílik arra, hogy mélyebb megfigyeléseket végezzünk és megalapozott előrejelzéseket készítsünk. E folyamat során nem csupán a jelenlegi trendeket ismerhetjük fel, hanem a feltörekvő technológiák erősségeit és gyengeségeit is feltárhatjuk. Ezek a technológiák új dimenziókat nyitnak meg az adatelemzésben, ugyanakkor kihívásokat is jelentenek, például az adatok minőségének biztosításában vagy az etikai szempontok figyelembevételében. A jövő kulcsa abban rejlik, hogy miként tudjuk ezeket az eszközöket hatékonyan integrálni a döntéshozatali folyamatokba, így nemcsak a jelenlegi helyzetet értelmezhetjük, hanem a jövőbeli lehetőségeket is előre jelezhetjük.

Ezek alapvetően olyan rendszerek, amelyek rendkívül összetett matematikai algoritmusokat alkalmaznak óriási adathalmazok feldolgozására – ennyi a lényeg. Az emberek interakcióba léphetnek velük, de a kommunikáció egyoldalú. A digitális rendszer nem rendelkezik öntudattal, így nincs tudomása arról, amit "végez", vagy arról, hogy mi zajlik a környezetében.

Ez nem azt jelenti, hogy a mesterséges intelligencia ne szolgálhatna az emberiség vagy a Föld javára. Sőt, bizonyos területeken, ahol a képességei meghaladják a miénket, bátran támaszkodhatunk rá, sőt, szükségszerű, hogy ezt megtegyük. Ugyanakkor elengedhetetlen, hogy aktívan foglalkozzunk azzal is, hogy minimalizáljuk az általa felvetett etikai kockázatokat. Az emberi jogok védelmén alapuló mesterséges intelligencia fejlesztése, valamint egy olyan ENSZ-ügynökség létrehozása, amely az adatalapú rendszerek kezelésével foglalkozik, kulcsfontosságú lépés lenne ennek a célnak az eléréséhez.

Az utóbbi húsz év során a nagy technológiai óriások fokozatosan elszigetelték az embereket egymástól, és a közösségi média révén szétszakították a társadalmainkat. Ezt a jelenséget talán pontosabban "antiszociális médiának" nevezhetnénk, hiszen a függőséget keltő és romboló hatása nyilvánvaló. Most pedig ezek a vállalatok egy teljesen új elképzelést hirdetnek: az emberi kapcsolatokat "AI-barátokkal" és "AI-társakkal" kívánják helyettesíteni.

Ugyanakkor ezek a vállalatok továbbra sem vesznek tudomást az úgynevezett fekete doboz problémáról: az automatizált értékelések, előrejelzések és döntések mögött álló algoritmikus folyamatok követhetetlenségéről, kiszámíthatatlanságáról és átláthatóságának hiányáról. Ez az átláthatatlanság az elfogult és diszkriminatív algoritmusok nagy valószínűségével elkerülhetetlenül elfogult és diszkriminatív eredményeket okoz.

A digitális rendszerek (DS) által generált kockázatok nem csupán elméleti spekulációk. Ezek a technológiák már most is egyre inkább befolyásolják mindennapi életünket, káros hatásokat gyakorolva a magánéletünkre és a szakmai kapcsolatainkra. Gazdasági és politikai manipulációval találkozunk, miközben a technológiai vállalatok vezetői arra ösztönöznek minket, hogy bízzunk meg a DS-eszközökben, és hagyjuk, hogy ezek irányítsák döntéseinket. Azért, hogy megőrizzük saját szabadságunkat, valamint a jövő generációk méltóságát, elengedhetetlen, hogy ellenálljunk a gépek manipuláló hatásának, és ne engedjük, hogy azok emberi minőségbe burkolózzanak.

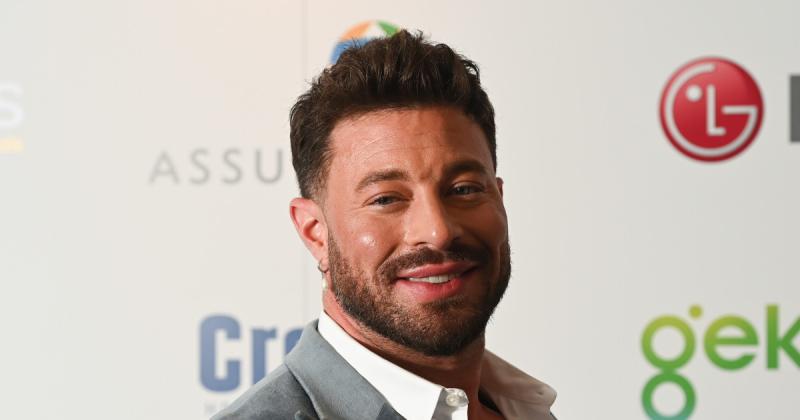

Peter G. Kirchschläger

Az etikai tudományok szakértője, a Luzerni Egyetem ISE Társadalmi Etikai Intézetének vezetője, valamint vendégprofesszorként tevékenykedik az ETH Zürich-en.